에너지 효율 75% 개선…추론 중심 AI 전환 대응 메모리 경쟁력 강화

[소셜밸류=최연돈 기자] SK하이닉스가 엔비디아 차세대 AI 서버 플랫폼용 메모리 모듈인 SOCAMM2 192GB 제품 양산에 나섰다.

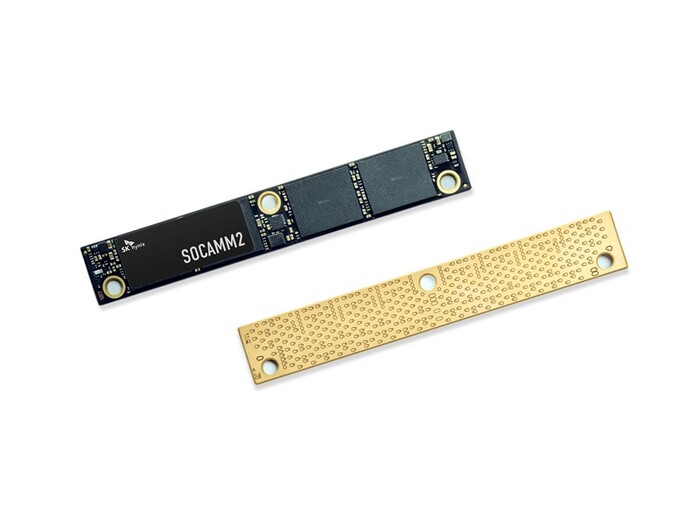

SK하이닉스는 10나노급 6세대(1c) LPDDR5X 기반 SOCAMM2 192GB 제품을 본격 양산한다고 20일 밝혔다.

SOCAMM2는 저전력 모바일 메모리인 LPDDR을 서버용으로 확장한 차세대 AI 서버 특화 메모리 모듈이다. 얇은 두께와 높은 확장성을 갖췄으며 압착식 커넥터 구조를 적용해 신호 무결성과 교체 편의성을 높인 것이 특징이다.

|

| ▲SK하이닉스 10나노급 6세대(1c) LPDDR5X 저전력 D램 기반 차세대 메모리 모듈 규격인 SOCAMM2 192GB(기가바이트)/사진=SK하이닉스 제공 |

이번 제품은 엔비디아의 차세대 AI 플랫폼 베라 루빈에 최적화해 설계됐다. 수천억개 파라미터 규모 초거대 AI 모델의 학습과 추론 과정에서 발생하는 메모리 병목 현상을 줄이고 시스템 처리 속도를 높이는 데 초점이 맞춰졌다.

1c 나노 공정을 적용한 이 제품은 기존 서버용 RDIMM 대비 2배 이상의 대역폭을 구현하고 에너지 효율은 75% 이상 개선했다고 회사는 설명했다. 고대역폭과 저전력 특성을 동시에 확보해 AI 추론 수요 확대에 대응하는 차세대 메모리 솔루션이라는 평가다.

특히 AI 시장이 학습 중심에서 추론 중심으로 이동하면서 저전력 고성능 메모리 수요가 빠르게 커지는 점도 반영됐다. 글로벌 클라우드 서비스 사업자(CSP) 수요에 대응하기 위해 양산 체제 안정화도 조기에 마쳤다고 회사는 설명했다.

업계에서는 엔비디아 차세대 플랫폼 대응 메모리를 조기 양산한 점이 SK하이닉스의 AI 메모리 주도권 강화 측면에서 의미가 있다는 평가가 나온다. 고대역폭메모리(HBM)에 이어 서버용 차세대 저전력 메모리 시장에서도 포트폴리오를 확대하는 흐름이라는 분석이다.

김주선 SK하이닉스 AI Infra 사장은 “SOCAMM2 192GB 공급으로 AI 메모리 성능의 새로운 기준을 세웠다”며 “글로벌 AI 고객과 협력을 강화해 AI 메모리 솔루션 경쟁력을 높여가겠다”고 말했다.

[저작권자ⓒ 사회가치 공유 언론-소셜밸류. 무단전재-재배포 금지]